9 juin 2026

5 min

5 min

Bienvenue sur LeFil.vet

L'accès au site web nécessite d'être identifié.

Merci de saisir vos identifiants de connexion.

Indiquez votre email dans le champ ci-dessous.

Vous recevrez un email avec vos identifiants de connexion.

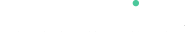

Le 2 juin, la FACCO* a dévoilé ses statistiques actualisées du parc des animaux familiers en France. Le baromètre FACCO-ODOXA, désormais annuel, montre une baisse générale des effectifs d'animaux de compagnie détenus dans l'hexagone.

Le nombre total d'animaux recensés est ainsi de 73,4 millions, contre 79 millions l'année précédente, mais 75 millions en 2024 (voir LeFil du 11 juin 2024).

Parmi les petits mammifères, les lapins, hamsters et furets sont les plus nombreux (1,7, 1,1 et 0,5 millions, respectivement).

Ces estimations sont issues d'un sondage effectué sur la période juin 2025-février 2026 (10 098 personnes interrogées, en France métropolitaine).

À 60 % encore, les Français sont propriétaires d'au moins un animal de compagnie : 39 % possèdent (au moins) un chat, mais 28 % possèdent désormais (au moins) un chien, une proportion en baisse de 2 points en 2 ans. D'ailleurs, seuls 8 % des chiens ont été nouvellement acquis (en 2024), contre 10 % et 11 % acquis en 2022 et 2023, respectivement.

Au global, 54 % des Français possèdent un chien ou un chat.

Le baromètre permet de dégager quelques critères orientant la possession d'un chien ou d'un chat, en particulier l'habitat (davantage d'animaux vivent en zone rurale ou dans les petites villes, par exemple), l'âge des propriétaires et la taille du foyer (présence d'enfants), les catégories socio-professionnelles pour les chiens, mais pas pour les chats.

Ces chiens et chats sont âgés de 6 à 7 ans en moyenne (dans les 2 espèces), et décèdent vers 12 ans en moyenne.

Depuis 2014, la médicalisation des chiens et, surtout, des chats a bien progressé : elle atteint 88 % pour les premiers (+ 4 points) et 69 % pour les seconds (+ 12 points).

En lien probablement, 56 % des chiens sont désormais stérilisés (hausse de 3 points en 2 ans) et 87 % des chats (+ 2 points depuis 2024).

Sans évolution notable, une large majorité de chiens est identifiée (89 %), tandis que bien qu'elle ne fasse que progresser dans le temps, la proportion des chats identifiés dépasse à peine les deux tiers (67 %, contre 63 % en 2024 puis 65 % en 2025).

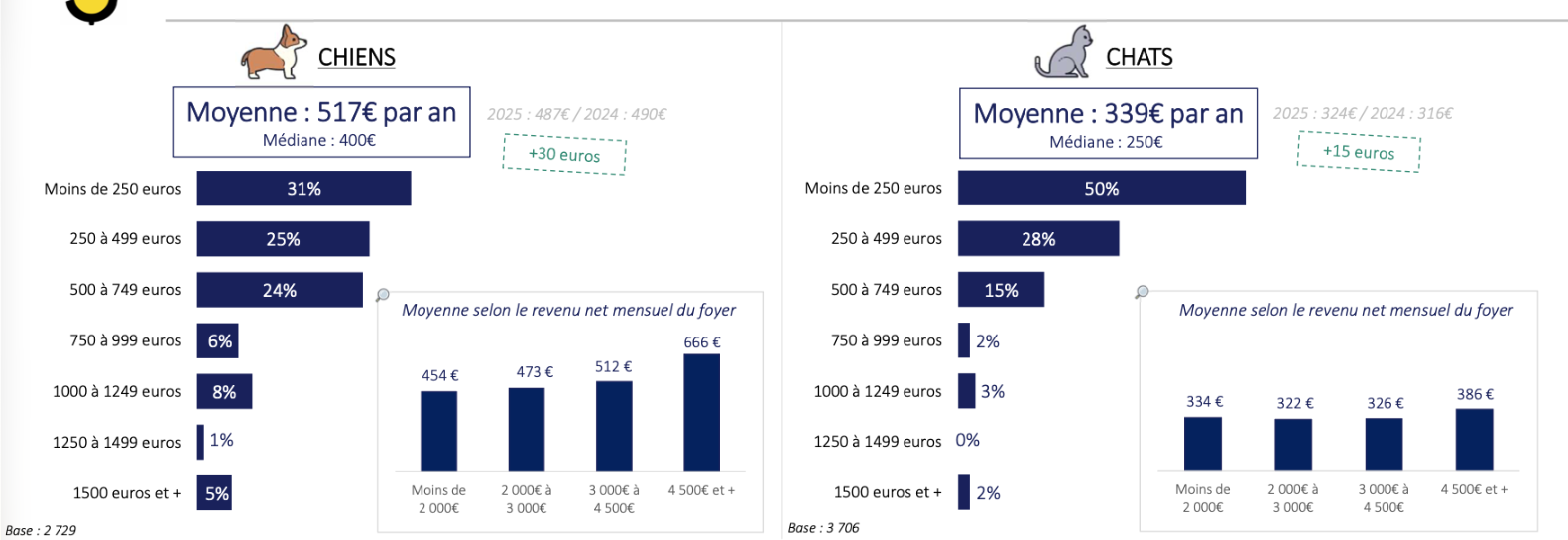

Le budget annuel moyen alloué à l'alimentation d'un chien est de 517 € en moyenne (400 € en médiane). Il est ainsi en hausse de 30 € sur une année, ce qui est logique compte tenu de l'augmentation générale des prix.

Un propriétaire sur 3 consacre moins de 250 € à ce poste, mais 24 % lui consacrent de 500 à 750 € (voir figure 2 ci-dessous).

Pour un chat, ce budget est de 339 € en moyenne (250 € en médiane), en hausse, lui aussi, de 15 € sur un an. Dans la moitié des cas, la somme est inférieure à 250 €, mais pour 28 % des propriétaires, il monte jusqu'à 500 €.

Figure 2. Budget annuel moyen alloué à l'alimentation de l'animal

Source : Sondage Odoxa pour la FACCO. Juin 2026.

Les croquettes dominent toujours largement le type d'aliment principalement ou régulièrement distribué (à 84 % des chiens et 88 % des chats).

Mais les restes de tables sont donnés à 40 % des chiens (36 % en 205) et à 18 % des chats (20 % en 2025). Des friandises, éventuellement occasionnelles, sont aussi offertes à la moitié des chiens et à un tiers environ des chats.

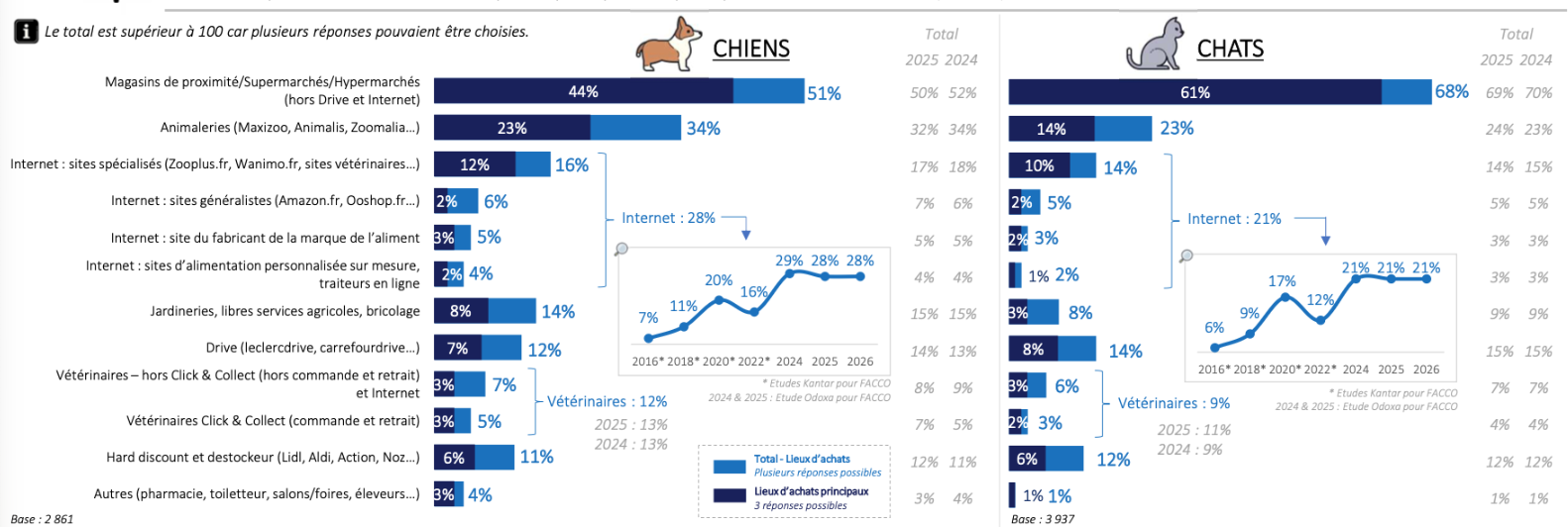

Après une progression relativement régulière depuis 2016, les achats sur Internet plafonnent depuis 2 ans, à 28 % concernant les chiens et 21 % pour les chats (voir figure 3 ci-dessous). Ainsi, les repas préparés frais et achetés en ligne, par exemple, sont donnés à 9 % des chiens et 5 % des chats.

La proportion des propriétaires se fournissant chez leur vétérinaire pour les aliments reste limitée, à 12 % pour un chien et à 9 % pour un chat. Les achats en supermarché restent largement dominants, devant ceux en animalerie.

Figure 3. Lieux d'achat de nourriture

Source : Sondage Odoxa pour la FACCO. Juin 2026.

* FACCO : Fédération des fabricants d'aliments pour chiens, chats, oiseaux et autres animaux familiers.

9 juin 2026

5 min

5 min

8 juin 2026

5 min

5 min

5 juin 2026

3 min

3 min

4 juin 2026

3 min

3 min

3 juin 2026

4 min

4 min